Kürzlich erschien MedGemma und ist nun auch bei Hugging Face und Ollama verfügbar. Als Basis diente Gemma 3. Es gibt weitere Modelle für den Gesundheitsbereich, beispielsweise Meditron, welches auf Llama 2 basiert. Für den vorliegenden Test habe ich mich auf das neu erschienene MedGemma beschränkt. MedGemma benötigt für die grösste Version zudem weniger Resourcen (27B Q4, 17GB) als Meditron (70B Q4, 39GB).

Online gibt es mächtige KI Dienste wie Sand am Meer. Leider bleibt der Datenschutz dabei auf der Strecke. Im medizinischen Bereich ist es keine Option, Patientendaten via KI Abfragen zu exponieren. Hier gilt das gleiche wie bei E-Mail, keine seriöse medizinische Einrichtung versendet diese unverschlüsselt.

Ein sicherer Onlinedienst für KI-Anwendungen ist daher unerlässlich. SwissGPT entwickelt für grosse Institutionen passgenaue Lösungen. Bei genaueren Abklärungen zeigt dann aber oft, dass Schnittstellen für Integrationen an bestehende Praxissoftware nicht vorhanden sind. Zudem können zurzeit nur 30 Dokumente zur Analyse hochgeladen werden.

Ein LLM lokal zu betreiben, benötigt geeignete Hardware und entsprechendes Wissen.

Bei PopNet und Kaformatik beschäftigen sich Spezialisten schon längere Zeit intensiv mit KI-Lösungen. Eine in Spiez lokalisierte Infrastruktur steht kurz vor Inbetriebnahme. So wäre es auch möglich, die Datenmenge zu skalieren und Abläufe individuell zu automatisieren.

Vorteile von lokalen KI-Diensten

- RAG (Retrieval Augmented Generation) oder Knowledge Stack: Eigene Dokumente wie .md, pdf oder .docx dienen als Wissensdatenbank für die KI in einer sicheren Umgebung.

- Hohe Datenschutzstandards.

- Spracherkennung, transkribieren in Text.

- Bearbeitung von Transkripten nach Diktat mit MedGemma zur Korrektur der medizinischen Terminologie.

- Keine Abo-Gebühren

Die Vorzüge von lokaler KI sind auch hier erläutert:

[Die grosse KI-Migration].

Ich verwende einen [Mac Studio als KI-Server]. Ollama ist als Dienst aufgesetzt und läuft stabil und zuverlässig. Um MedGemma zu testen, verwende ich das Terminal. Welche Software als grafische Oberfläche den KI-Server bedienen kann, werde ich in einem weiteren Beitrag erläutern.

Die Publikation von MedGemma findet sich hier:

https://research.google/blog/medgemma-our-most-capable-open-models-for-health-ai-development/

Mit [Obsidian Web Clipper] habe ich den Inhalt übertragen und in Obsidian mit MedGemma auf Deutsch übersetzt. Das wäre auch mit Google Translate direkt auf der Webseite möglich, hier wollte ich testen wie es mit dem neuen Modell funktioniert. Die Übersetzung wurde, abgesehen von wenigen Korrekturen für die bessere Darstellung, nicht weiter bearbeitet.

Der Test findet sich weiter unten:

Publikation

MedGemma: Unsere leistungsfähigsten offenen Modelle für die Entwicklung von KI im Gesundheitswesen

9.7.2025 - Daniel Golden, Engineering Manager, und Rory Pilgrim, Product Manager, Google Research

Wir stellen neue multimodale Modelle in der MedGemma-Sammlung vor, unsere leistungsfähigsten offenen Modelle für die Entwicklung von Gesundheits-KI.

Die Gesundheitsbranche umfasst zunehmend KI, um Workflow-Management, Patientenkommunikation und Diagnose- und Behandlungsunterstützung zu verbessern. Es ist wichtig, dass diese KI-basierten Systeme nicht nur leistungsfähig, sondern auch effizient und datenschutzkonform sind. Mit diesen Überlegungen im Hinterkopf haben wir Health AI Developer Foundations (HAI-DEF) entwickelt und kürzlich veröffentlicht. HAI-DEF ist eine Sammlung von leichten, offenen Modellen, die Entwicklern robuste Ausgangspunkte für ihre eigene Gesundheitsforschung und Anwendungsentwicklung bieten. Da die HAI-DEF-Modelle offen sind, behalten Entwickler die volle Kontrolle über Datenschutz, Infrastruktur und Modifikationen an den Modellen. Im Mai dieses Jahres haben wir die HAI-DEF-Sammlung um MedGemma erweitert, eine Sammlung von generativen Modellen basierend auf Gemma 3, die darauf abzielen, die Entwicklung von Gesundheits- und Lebenswissenschaften-KI zu beschleunigen.

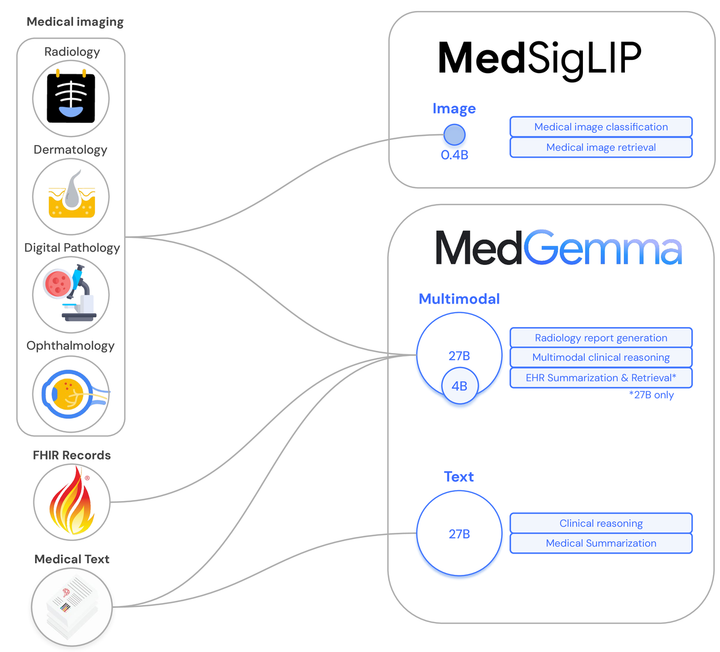

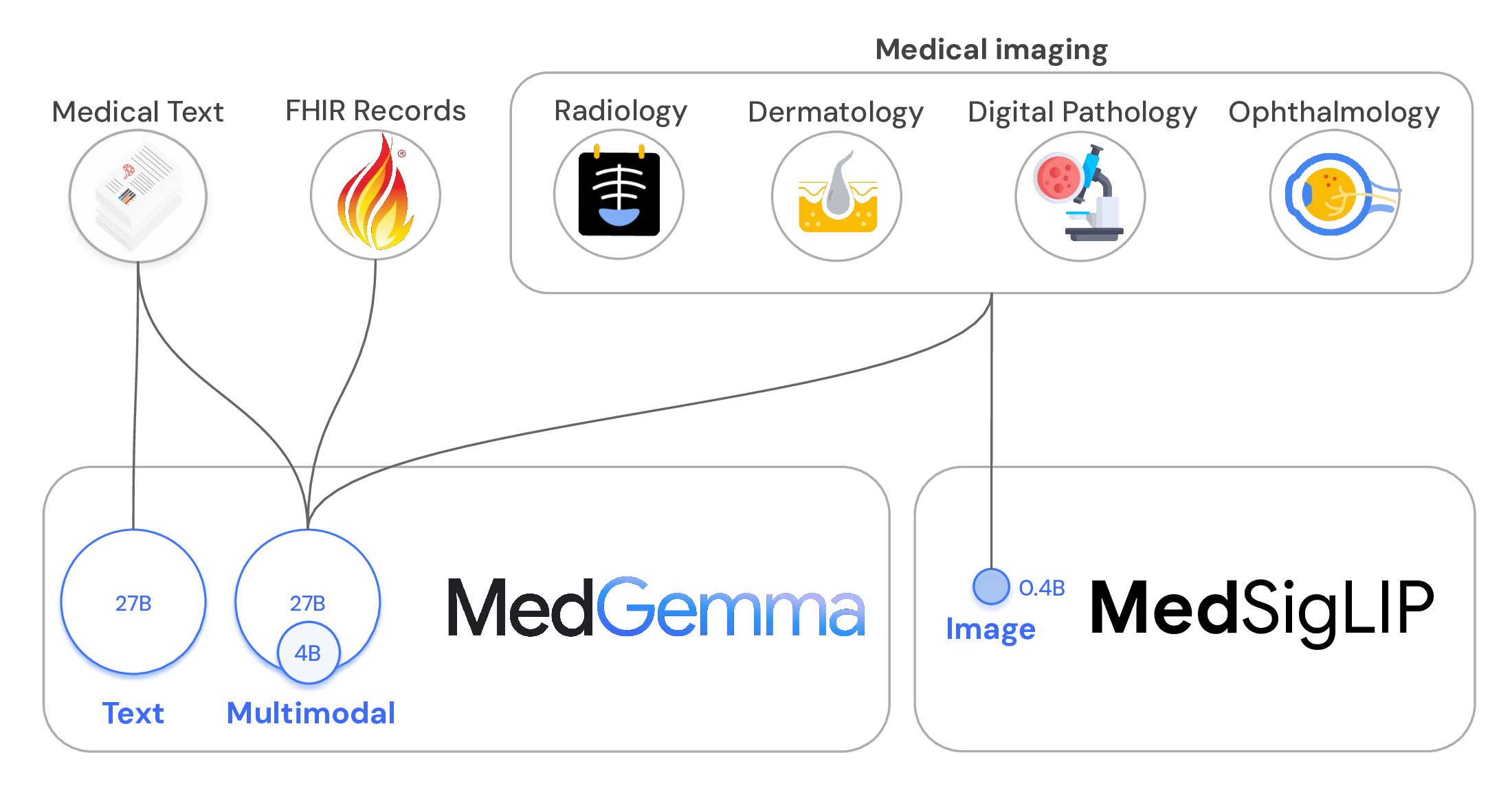

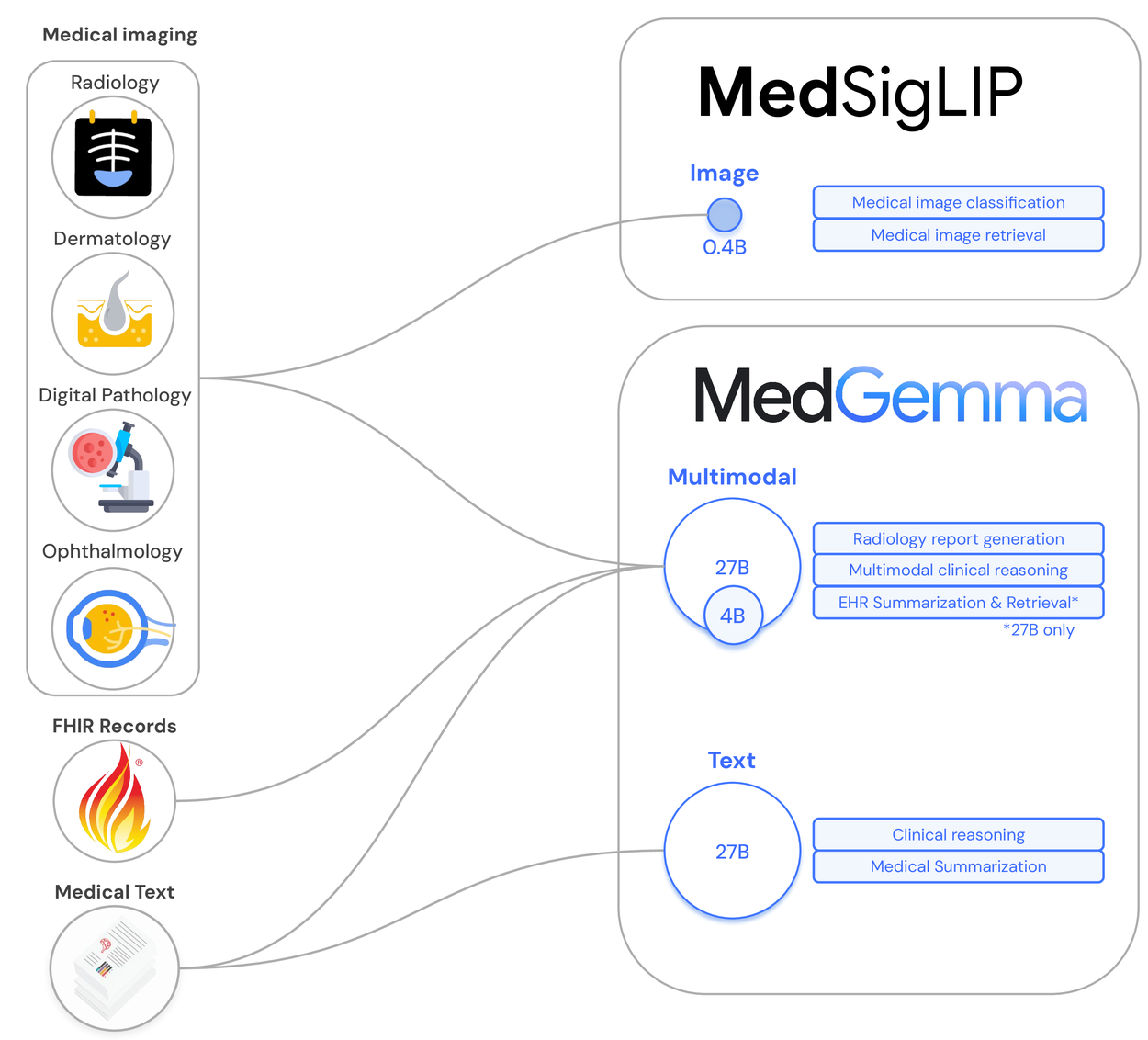

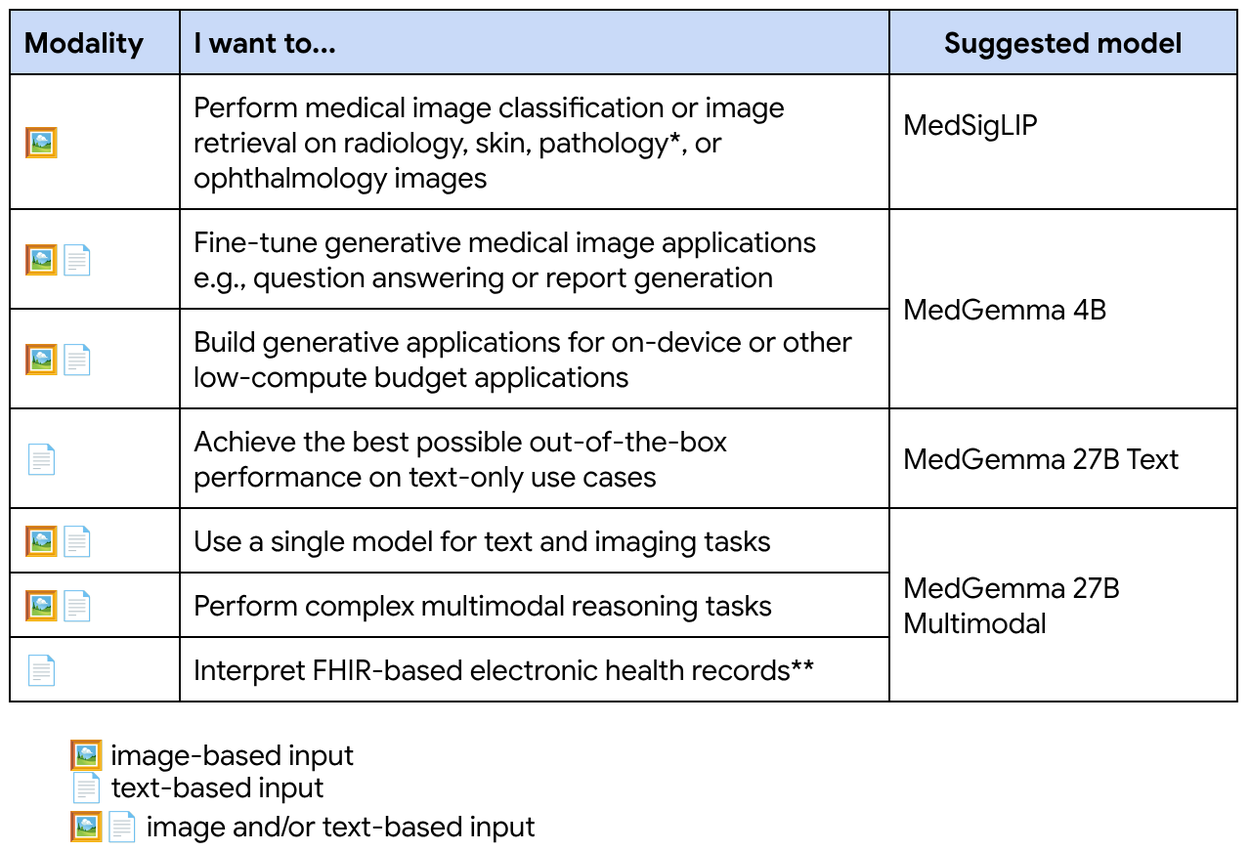

Heute stellen wir zwei neue Modelle in dieser Sammlung vor. Das erste ist MedGemma 27B Multimodal, das die zuvor veröffentlichten 4B Multimodal- und 27B-Text-Only-Modelle ergänzt, indem es Unterstützung für komplexe multimodale und longitudinale elektronische Gesundheitsakte-Interpretation hinzufügt. Das zweite neue Modell ist MedSigLIP, ein leichtes Bild- und Textencoder für Klassifizierung, Suche und verwandte Aufgaben. MedSigLIP basiert auf demselben Bildencoder, der die 4B- und 27B-MedGemma-Modelle antreibt.

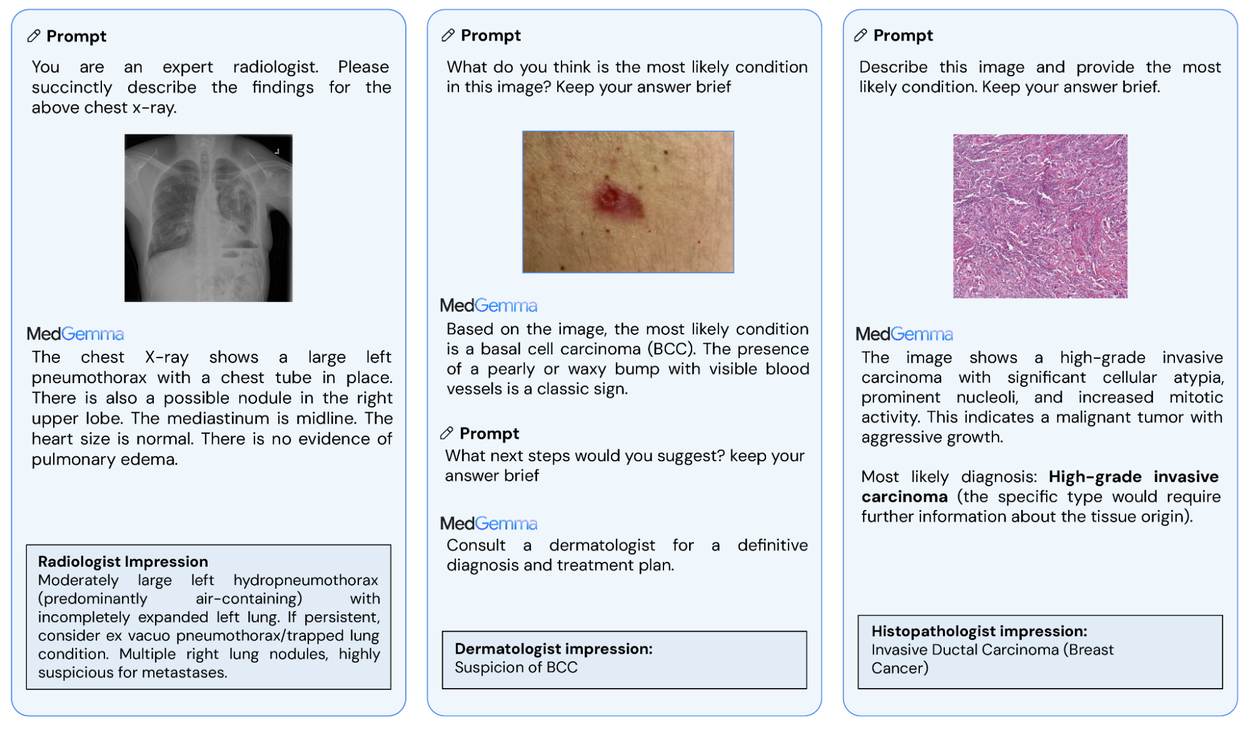

MedGemma und MedSigLIP sind starke Ausgangspunkte für medizinische Forschung und Produktentwicklung. MedGemma ist nützlich für medizinische Text- oder Bildaufgaben, die freie Textgenerierung erfordern, wie z. B. Berichterstellung oder visuelle Fragenbeantwortung. MedSigLIP wird für Bildaufgaben empfohlen, die strukturierte Ausgaben wie Klassifizierung oder Abruf erfordern. Alle oben genannten Modelle können auf einer einzelnen GPU ausgeführt werden, und MedGemma 4B und MedSigLIP können sogar auf mobilen Geräten ausgeführt werden.

Details zur Entwicklung und Bewertung von MedGemma und MedSigLIP können im technischen Bericht MedGemma gefunden werden.

MedGemma: Ein multimodales generatives Modell für die Gesundheit

Die MedGemma-Sammlung umfasst Varianten in den Grössen 4B und 27B, die beide Bild- und Texteingaben akzeptieren und Textausgaben erzeugen.

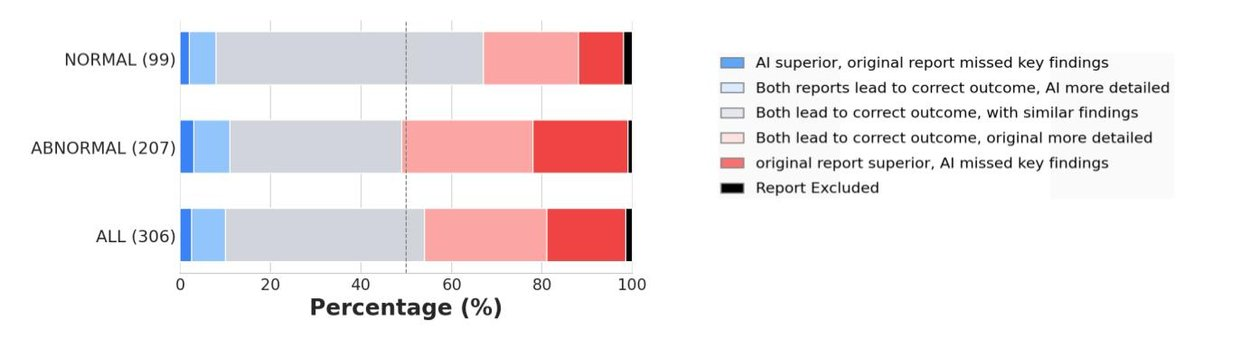

- MedGemma 4B Multimodal: MedGemma 4B erreicht eine Punktzahl von 64,4% bei MedQA, was es zu einem der besten sehr kleinen (<8B) offenen Modelle macht. In einer unblinden Studie wurden 81% der von MedGemma 4B generierten Röntgenberichte von einem US-amerikanischen, zertifizierten Radiologen als ausreichend genau bewertet, um zu ähnlichen Patientenmanagement-Entscheidungen wie die ursprünglichen Radiologenberichte zu führen. Es erreicht zudem Leistungen bei der medizinischen Bildklassifizierung, die mit denen von aufgaben-spezifischen, aktuellen Modellen vergleichbar sind.

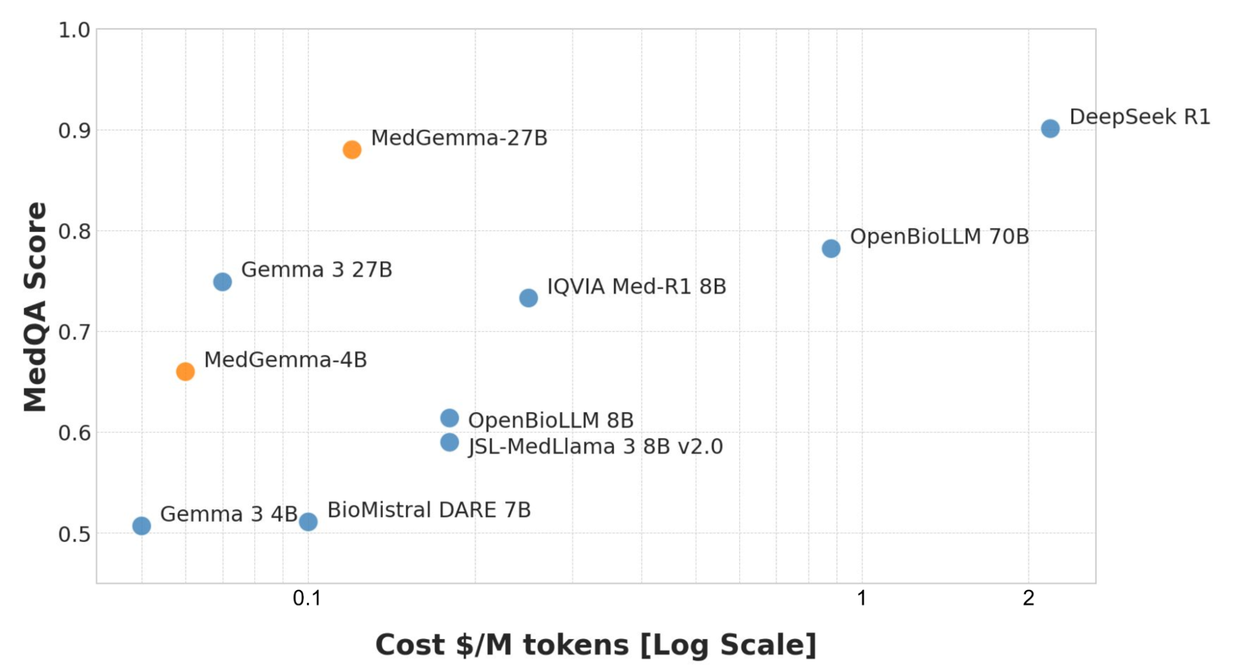

- MedGemma 27B Text und MedGemma 27B Multimodal: Basierend auf internen und veröffentlichten Bewertungen gehören die MedGemma 27B-Modelle zu den besten, kleinen offenen Modellen (<50B) im MedQA-Benchmark für medizinisches Wissen und Argumentationsvermögen; das Textmodell erreicht eine Punktzahl von 87,7%, was innerhalb von 3 Punkten des DeepSeek R1, eines führenden offenen Modells, liegt, aber bei etwa einem Zehntel der Inferenzkosten. Die MedGemma 27B-Modelle sind mit grösseren Modellen in einer Vielzahl von Benchmarks, einschliesslich der Interpretation und des Abrufs von elektronischen Gesundheitsdatensätzen, vergleichbar.

Bei MedQA gehören MedGemma 4B und 27B zu den leistungsstärksten Modellen ihrer Grösse. Beachten Sie, dass in dieser Grafik Kostenschätzungen auf Grundlage von Preisanalysen von legacy.lmarena.ai und together.ai/pricing erstellt wurden. Für Modelle, die nicht in der Bestenliste enthalten sind, haben wir Preisdaten von den Modellen verwendet, von denen sie abgeleitet wurden.

Basierend auf einer Review durch einen US-amerikanischen, zertifizierten kardiothorakalen Radiologen stellten wir fest, dass 81% der Berichte von MedGemma für Röntgenaufnahmen des Brustkorbs zu einer ähnlichen Patientenbehandlung führen würden wie die ursprünglichen Berichte des Radiologen.

Wir entwickelten diese Modelle, indem wir zunächst einen medizinisch optimierten Bildencoder trainierten (unabhängig als MedSigLIP veröffentlicht, siehe unten), gefolgt von der Ausbildung der entsprechenden 4B- und 27B-Versionen des Gemma 3-Modells anhand medizinischer Daten. Wir achteten darauf, die allgemeinen (nicht-medizinischen) Fähigkeiten von Gemma während dieses Prozesses beizubehalten. Dies ermöglicht es MedGemma, gute Leistungen bei Aufgaben zu erbringen, die medizinische und nicht-medizinische Informationen vermischen und die Anweisungen in nicht-englischen Sprachen befolgen.

Ein wichtiger Aspekt dieser Modelle ist ihre Anpassungsfähigkeit. Zum Beispiel kann MedGemma 4B nach einer Feinabstimmung eine Spitzenleistung bei der Erstellung von Röntgenberichten für die Brust erzielen, mit einem RadGraph F1-Wert von 30,3. Die einfache Möglichkeit für Entwickler, die Leistung bei ihren Zielanwendungen zu verbessern, unterstreicht den Wert von MedGemma als Ausgangspunkt für Entwickler, die KI für das Gesundheitswesen entwickeln möchten.

MedSigLIP: Ein spezialisierter Bildencoder für das Gesundheitswesen

MedSigLIP ist ein leichter Bildencoder mit nur 400 Millionen Parametern, der die Sigmoid-Verlustarchitektur für die Bildvorverarbeitung (SigLIP) verwendet. MedSigLIP wurde von SigLIP abgeleitet, indem es mit vielfältigen medizinischen Bilddaten wie Brust-Röntgenaufnahmen, histopathologischen Bildern, Hautbildern und Fundusbildern angepasst wurde, um das Modell zu ermöglichen, nuancierte Merkmale zu erlernen, die für diese Modalitäten spezifisch sind. Wichtig ist auch, dass wir sicherstellen, dass MedSigLIP eine starke Leistung bei natürlichen Bildern beibehält, auf denen das ursprüngliche SigLIP-Modell trainiert wurde, um seine Vielseitigkeit zu erhalten.

MedSigLIP ist darauf ausgelegt, die Lücke zwischen medizinischen Bildern und medizinischem Text zu schliessen, indem es diese in einen gemeinsamen Einbettungsraum kodiert. MedSigLIP erreicht eine ähnliche oder verbesserte Klassifikationsleistung im Vergleich zu aufgabenspezifischen Vision-Embedding-Modellen, während es vielseitiger bei medizinischen Bilddomänen ist.

MedSigLIP ist ideal für:

- Traditionelle Bildklassifizierung: Erstellen Sie leistungsstarke Modelle zur Klassifizierung medizinischer Bilder.

- Zero-Shot-Bildklassifizierung: Klassifizieren Sie Bilder ohne spezifische Trainingsbeispiele, indem Sie Bild-Embeddings mit Text-Embeddings vergleichen.

- Semantische Bildsuche: Finden Sie visuell oder semantisch ähnliche Bilder in grossen medizinischen Bilddatenbanken.

Die Macht offener Modelle

Da die MedGemma-Sammlung offen ist, können die Modelle heruntergeladen, weiterentwickelt und angepasst werden, um die spezifischen Bedürfnisse der Entwickler zu erfüllen. Insbesondere im medizinischen Bereich bietet dieser offene Ansatz mehrere deutliche Vorteile gegenüber API-basierten Modellen:

- Flexibilität und Privatsphäre: Modelle können auf proprietärer Hardware in der bevorzugten Umgebung des Entwicklers ausgeführt werden, einschliesslich Google Cloud Platform oder lokal, was Datenschutzbedenken oder institutionelle Richtlinien berücksichtigen kann.

- Anpassung für hohe Leistung: Modelle können angepasst und modifiziert werden, um eine optimale Leistung bei Zielaufgaben und -datensätzen zu erzielen.

- Wiederholbarkeit und Stabilität: Da die Modelle als Snapshots verteilt werden, sind ihre Parameter eingefroren und ändern sich nicht unerwartet im Laufe der Zeit, was insbesondere im medizinischen Bereich wichtig ist, wo Konsistenz und Wiederholbarkeit von entscheidender Bedeutung sind.

Um eine breite Zugänglichkeit und einfache Nutzung zu gewährleisten, bietet unsere Hugging Face-Sammlung MedSigLIP und MedGemma im beliebten Hugging Face-Safetensors-Format

Was Entwickler mit MedGemma & MedSigLIP bauen

Forscher und Entwickler haben MedGemma-Modelle verwendet, um ihre Anwendungsfälle zu lösen, und haben festgestellt, dass die Modelle in der Lage sind, einige entscheidende Probleme zu lösen. Entwickler bei DeepHealth in Massachusetts, USA, haben MedSigLIP verwendet, um die Brust-Röntgen- und Knoten-Erkennung zu verbessern. Forscher am Chang Gung Memorial Hospital in Taiwan haben festgestellt, dass MedGemma gut mit traditionellen chinesischen medizinischen Texten funktioniert und auf Fragen von medizinischem Personal antworten kann. Entwickler bei Tap Health in Gurgaon, Indien, haben festgestellt, dass MedGemma eine überlegene medizinische Grundlage bietet und zuverlässig bei Aufgaben ist, die eine Empfindlichkeit gegenüber klinischem Kontext erfordern, wie z. B. der Zusammenfassung von Fortschrittsberichten oder der Vorschlag von Richtlinien.

Wir sind gespannt darauf, zu erfahren, wie Entwickler MedGemma und MedSigLIP verwenden, um die nächste Generation von Gesundheits-KI-Tools zu erstellen.

VIDEO:

Erste Schritte und Erkundung

Um Entwicklern den Einstieg zu erleichtern, haben wir detaillierte Notebooks auf GitHub für MedGemma und MedSigLIP bereitgestellt, die zeigen, wie Instanzen von MedSigLIP und MedGemma sowohl für Inferenz als auch für Fine-Tuning auf Hugging Face erstellt werden können. Wenn Entwickler bereit sind, zu skalieren, können MedGemma und MedSigLIP nahtlos in Vertex AI als dedizierte Endpunkte bereitgestellt werden, und wir bieten Beispiele auf GitHub, wie Inferenzen auf diesen Endpunkten ausgeführt werden können. Wir haben auch eine neue Demo zu unserer HAI-DEF Hugging Face Demo-Sammlung hinzugefügt, die zeigt, wie MedGemma in eine Anwendung integriert werden kann, um die Informationsbeschaffung vor einem Patientenbesuch zu optimieren.

VIDEO:

Diese Demo zeigt, wie MedGemma in eine Anwendung integriert werden kann, um die Informationsbeschaffung vor einem Patientenbesuch zu optimieren. Der Code für die Demo ist auf der Hugging Face-Website verfügbar.

Hier ist die Übersetzung des ausgewählten Textes:

* Für krankheitsspezifische Anwendungen, die keine Sprachübereinstimmung erfordern, bietet Path Foundation eine hohe Leistung für dateneffiziente Klassifizierung und geringere Rechenanforderungen.

** Fast Healthcare Interoperability Resources (FHIR)-Datensätze sind textbasiert, haben jedoch eine einzigartige Struktur. Daten aus elektronischen Gesundheitsakten wurden nur in das Training des multimodalen Modells MedGemma 27B aufgenommen.

Bitte besuchen Sie die HAI-DEF-Website, um diese Ressourcen zu erhalten und mehr über die MedGemma-Sammlung und andere Health AI Developer Foundations-Modelle zu erfahren. Das HAI-DEF-Forum steht für Fragen oder Feedback zur Verfügung.

Hinweis zu Trainingsdatensätzen

Die Modelle wurden auf einer Mischung aus öffentlichen und privaten, anonymisierten Datensätzen trainiert. Google und seine Partner verwenden Datensätze, die sorgfältig anonymisiert oder anonymisiert wurden, um den Schutz von Einzelpersonen und Patienten zu gewährleisten.

Haftungsausschluss

MedGemma und MedSigLIP sind als Ausgangspunkt für die effiziente Entwicklung von nachgelagerten Gesundheitsanwendungen mit medizinischen Texten und Bildern gedacht. MedGemma und MedSigLIP sind nicht für die Verwendung ohne angemessene Validierung, Anpassung und/oder sinnvolle Modifikation durch Entwickler für ihren spezifischen Anwendungsfall gedacht. Die Ausgaben dieser Modelle sind nicht dazu bestimmt, direkt klinische Diagnosen, Patientenmanagement-Entscheidungen, Behandlungsempfehlungen oder andere direkte klinische Anwendungen zu informieren. Leistungsbenchmarks heben die grundlegenden Fähigkeiten auf relevanten Benchmarks hervor, aber selbst für Bild- und Textdomänen, die einen erheblichen Teil der Trainingsdaten ausmachen, sind ungenaue Modellausgaben möglich. Alle Modellausgaben sollten als vorläufig betrachtet werden und erfordern eine unabhängige Überprüfung, klinische Korrelation und weitere Untersuchungen durch etablierte Forschungs- und Entwicklungsmethoden.

Danksagung

MedGemma ist das Ergebnis einer Zusammenarbeit zwischen Google Research und Google DeepMind. Wir danken den vielen Menschen, die zu dieser Arbeit beigetragen haben, einschliesslich der Ingenieure und funktionsübergreifenden Mitglieder der Google Health AI- und Gemma-Teams sowie unserer Sponsoren bei Google Research und Google DeepMind.

Test mit MedGemma auf lokalem KI Server

Fallbeispiel

Als Zahnarzt praktiziere ich nicht mehr. Mit einer Lungenentzündung habe ich aber einschlägige Erfahrung. Kürzlich war ich auf einer [Ferienreise] einige Tage ausser Gefecht. Medizinisch wurde ich vor Ort gut betreut und hatte auch Kontakt mit meinem Hausarzt. Daher bin ich mit dem akutuellen Therapieschema vertraut.

Hinweis

KI Modelle sind höchstens hilfreiche Werkzeuge, aber keine Referenz. Dafür gibt es wissenschaftliche Publikationen, entsprechende Therapierichtlinien und erfahrene Ärzte. Eine Medizinalperson wird aber sicher dankbar für eine Entlastung von administrativen Nebengeräuschen sein.

Einsatzgebiete

- Mein Vater hatte in hohem Alter eine zunehmend komplexe Krankengeschichte. Es resultierte eine umfangreiche Sammlung von über zwanzig Arzt- und Behandlungsberichten. Mit lokaler Datenanalyse mit Hilfe von MedGemma kann ich eine Zusammenstellung aller Diagnosen erstellen lassen, welche nach dem Datum der ersten Erwähnung sortiert sind. Die Quelle werden bei der Antwort erwähnt.

- Erstellung von Berichten per Spracherkennung. Dafür gibt es seit Jahren Standardsoftware. Die Nachbearbeitung mit einem medizinisch trainierten LLM eröffnet jedoch neue Möglichkeiten zur Qualitätssteigerung und zur strukturierten Ausgabe.

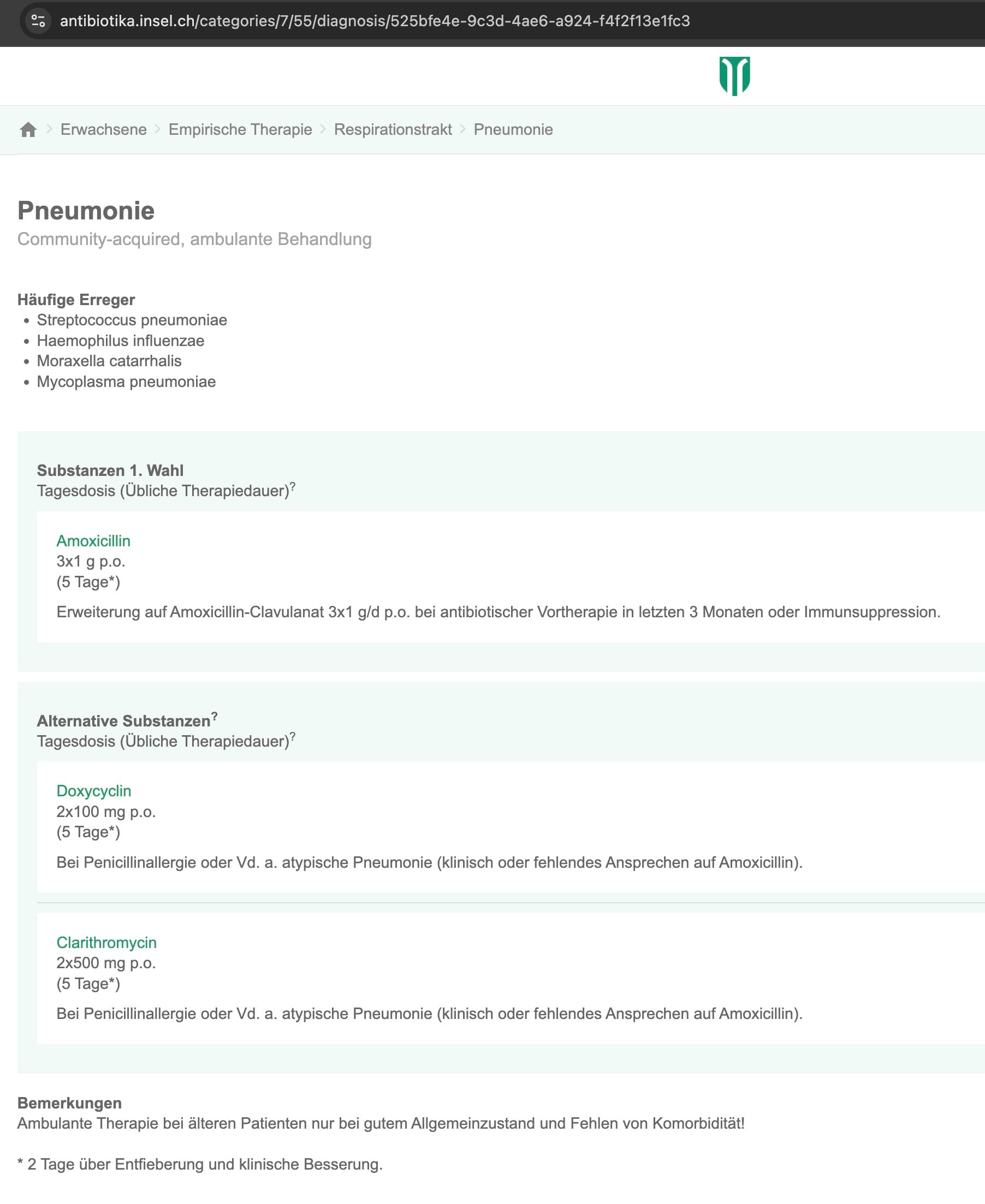

Referenz

Inselspital, Antibiotikarichtinien

Peumonie

https://antibiotika.insel.ch/categories/7/55/diagnosis/525bfe4e-9c3d-4ae6-a924-f4f2f13e1fc3

Anfrage an MedGemma (27B Q4 Modell)

Prompt

pp@MacStudio2025 ~ >ollama run alibayram/medgemma:27b --verbose

erläutere die antibiotika behandlung bei einer pneumonie (community-acquired, ambulante behandlung): welche wirkstoffe, und in welcher dosierung sollen wie lange eingenommen werden?

Antwort siehe unten...

total duration: 1m0.322410625s

load duration: 57.896208ms

prompt eval count: 50 token(s)

prompt eval duration: 659.528542ms

prompt eval rate: 75.81 tokens/s

eval count: 1415 token(s)

eval duration: 59.604437292s

eval rate: 23.74 tokens/s

Antwort von MedGemma

Die antibiotische Behandlung einer ambulant erworbenen Pneumonie (CAP) hängt von verschiedenen Faktoren ab, einschließlich des

Schweregrades der Erkrankung, des Alters des Patienten, Vorerkrankungen, möglicher Risikofaktoren für resistente Erreger und lokalen

Resistenzmustern. Hier ist eine allgemeine Übersicht über die gängigen Ansätze:

Grundlagen der Behandlung:

- Ziel: Abdeckung der häufigsten bakteriellen Erreger, die CAP verursachen (typischerweise Streptococcus pneumoniae,

Haemophilus influenzae, Moraxella catarrhalis, atypische Erreger wie Mycoplasma pneumoniae, Chlamydophila pneumoniae,

Legionella pneumophila). - Empirische Therapie: Da der genaue Erreger oft nicht sofort bekannt ist, wird zunächst eine empirische Therapie basierend auf

Wahrscheinlichkeiten und lokalen Mustern gewählt. - Anpassung: Die Therapie kann später angepasst werden, wenn mikrobiologische Ergebnisse (z.B. aus Sputum oder Blut) vorliegen

oder sich der Patient nicht wie erwartet verbessert.

Antibiotika-Optionen (oral, für ambulante Behandlung):

Die Wahl des Antibiotikums richtet sich nach dem Schweregrad und Risikofaktoren:

- Für gesunde Erwachsene ohne Risikofaktoren für resistente Erreger und ohne kürzliche Antibiotikagabe:

- Amoxicillin: 1000 mg 3-mal täglich. (Gute Wahl für S. pneumoniae).

- Doxycyclin: 100 mg 2-mal täglich. (Breiteres Spektrum, deckt auch atypische Erreger ab).

- Makrolid (Azithromycin, Clarithromycin):

- Azithromycin: 500 mg einmal täglich (oder 250 mg nach erster Dosis von 500 mg).

- Clarithromycin: 500 mg 2-mal täglich.

(Deckt S. pneumoniae und atypische Erreger ab, aber zunehmende Resistenzen bei S. pneumoniae sind ein Problem).

- Für Erwachsene mit Komorbiditäten (z.B. COPD, Diabetes, Herzinsuffizienz, Nierenerkrankung, Lebererkrankung) oder kürzlicher

Antibiotikagabe (innerhalb der letzten 3 Monate):- Kombination: Ein Beta-Lactam (Amoxicillin/Clavulansäure) plus ein Makrolid (Azithromycin, Clarithromycin) oder

Doxycyclin.- Beispiel: Amoxicillin/Clavulansäure 875/125 mg 2-mal täglich plus Azithromycin 500 mg einmal täglich.

- Beispiel: Amoxicillin/Clavulansäure 875/125 mg 2-mal täglich plus Doxycyclin 100 mg 2-mal täglich.

- Alternativ: Ein orales Cephalosporin (z.B. Cefpodoxim, Cefuroxim) plus ein Makrolid oder Doxycyclin.

- Alternativ: Ein orales Fluorchinolon (Levofloxacin, Moxifloxacin) allein. (Sollte aufgrund möglicher Nebenwirkungen und

Resistenzentwicklung nur erwogen werden, wenn andere Optionen nicht geeignet sind).

- Kombination: Ein Beta-Lactam (Amoxicillin/Clavulansäure) plus ein Makrolid (Azithromycin, Clarithromycin) oder

- Für Risikofaktoren für Pseudomonas aeruginosa (selten bei ambulanter Behandlung, z.B. schwere COPD, Bronchiektasen, häufige

Antibiotikaeinnahme):- Hier sind spezielle Antibiotika erforderlich, oft in Kombination, wie z.B. ein orales Fluorchinolon (Ciprofloxacin,

Levofloxacin) plus ein anderes passendes Antibiotikum. Diese Fälle werden meist stationär behandelt.

- Hier sind spezielle Antibiotika erforderlich, oft in Kombination, wie z.B. ein orales Fluorchinolon (Ciprofloxacin,

Dauer der Behandlung:

- In der Regel 5-7 Tage.

- Die Behandlungsdauer sollte mindestens bis 48-72 Stunden nach Abklingen von Fieber, Husten und anderen Symptomen fortgesetzt

werden. - Bei Legionella-Pneumonie oder schweren Fällen kann eine längere Dauer (bis zu 10-14 Tage) erforderlich sein.

Wichtige Hinweise:

- Keine Selbstmedikation: Antibiotika sollten nur nach ärztlicher Verschreibung und Anweisung eingenommen werden.

- Vollständige Einnahme: Die gesamte verschriebene Dosis muss eingenommen werden, auch wenn man sich besser fühlt, um eine

vollständige Ausheilung zu gewährleisten und Resistenzen zu vermeiden. - Nebenwirkungen: Auf mögliche Nebenwirkungen achten und diese dem Arzt melden.

- Lokale Richtlinien: Die genauen Empfehlungen können je nach lokalen Resistenzmustern und nationalen Leitlinien variieren.

Dein Arzt wird die für dich passende Therapie auswählen. - Veränderungen: Bei Verschlechterung des Zustands, fehlender Besserung nach 48-72 Stunden oder Auftreten neuer Symptome sollte

umgehend ein Arzt konsultiert werden.

Zusammenfassungstabelle (vereinfacht):

| Patientengruppe | Empfohlene Antibiotika (oral) | Dauer (ungefähr) |

|---|---|---|

| Gesunde Erwachsene, keine Risikofaktoren | Amoxicillin, Doxycyclin, Makrolid (Azithromycin, Clarithromycin) | 5-7 Tage |

| Erwachsene mit Komorbiditäten / frühere Antibiotika | Beta-Lactam + Makrolid (z.B. Amoxicillin/Clavulansäure + Azithromycin) ODER Beta-Lactam + Doxycyclin ODER orales Fluorchinolon (Levofloxacin, Moxifloxacin) (als Alternative) | 5-7 Tage |

Disclaimer: Diese Informationen dienen nur der allgemeinen Orientierung und ersetzen keine professionelle medizinische Beratung.

Die Behandlung einer Pneumonie muss individuell vom behandelnden Arzt festgelegt werden.